BenGER – Benchmark for German Law

Als Teil des Arbeitspakets unserer Gruppe im Projekt Titan erarbeiten wir im Rahmen einer offenen Kooperation eine holistische Benchmark für das deutsche Recht. Dabei erstellen wir zunächst die nötige Infrastruktur (die Plattform) für uns und die Community, und sammeln dann in großem Stil Aufgaben, Daten und Annotationen, um in einem Rundumschlag die Performance sämtlicher state of the art Modelle zusammen mit robusten menschlichen Baselines zu veröffentlichen (Datensatz).

1) Plattform

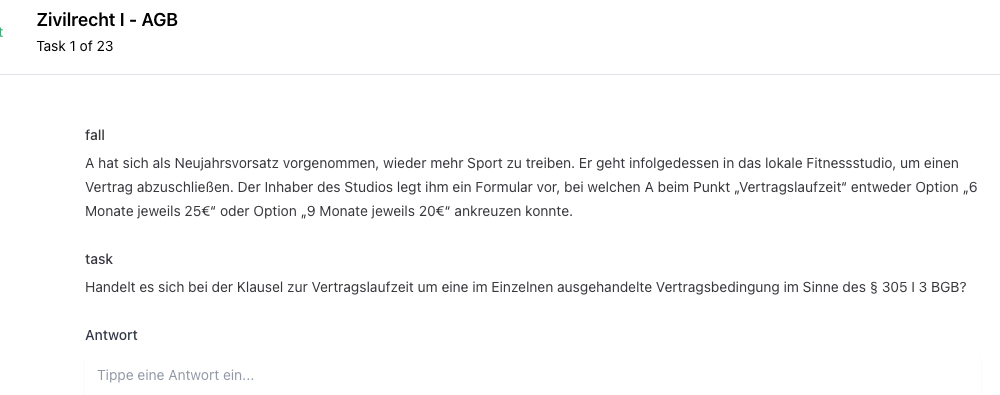

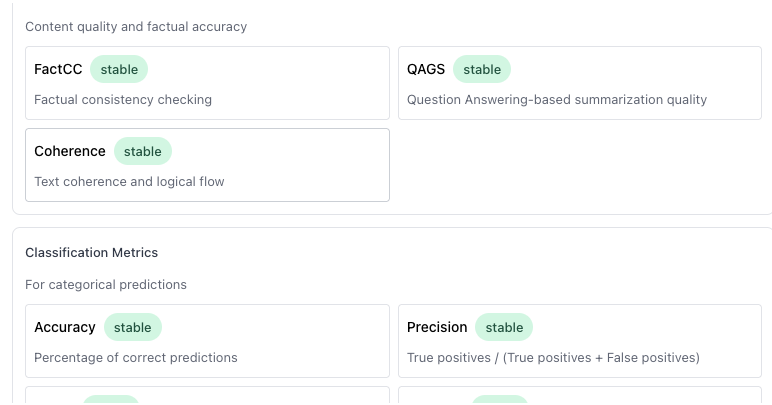

Unter what-a-benger.net findet sich bereits ein früher release der Plattform (zur vollen Nutzung ist eine Freischaltung durch unsere Gruppe erforderlich). Diese befindet sich noch in der aktiven Fortentwicklung, hat aber bereits einige aktive Nutzer:innen aus der Community. Kern der Plattform ist eine niederschwellige Möglichkeit, eigene juristsiche Aufgaben und Fragestellungen einzupflegen, Menschen wie Modelle (wir unterstützen über 50 große Sprachmodelle) diese Aufgaben lösen zu lassen, und dann nach wissenschaftlich bewährten Kriterien auswerten zu lassen.

Als Anreiz für Annotator:innen (i.d.R. Jura-Studierende) bieten wir eine Vielzahl juristischer Aufgaben mit unmittelbarem LLM-Feedback nach Bearbeitung sowie ein pseudonymisiertes (auf Wunsch auch mit Klarnamen) Leaderboard, um ein ehrliches Bild über die eigene Leistung zu bekommen.

Die Plattform wird zeitnah auf dem demo track einer Konferenz eingereicht werden; nach Akzeptanz planen wir eine Veröffentlichung als freie Software.

2) Datensatz

Dank eines massiven Supports aus der Community (Universitäten, NGOs und Studierende!) sind wir in der Lage, in absehbarer Zeit einen großen Datensatz echter juristischer Fälle aus der Ausbildung, anonymisierte Lösungen, Modell-Antworten und vollständige Metriken dazu bereitzustellen. Stay tuned!